AI人格性

Also known as: AIの法的人格性, 機械の人格性, AIの権利, AIの法的地位

AI人格性とは何か?

AI人格性は、人工知能システムに「人格」として認識されるある種のステータスを付与する法的および哲学的概念を指します。つまり、法律に基づいて権利、責任、および潜在的な責任を持つエンティティです。これは必ずしもAIが人間と同じ権利を持つことを意味するのではなく、むしろ法的枠組みがAIエージェントを経済的、法的、および社会的システムの参加者として認識することを意味します。

この概念は既存の法的先例に基づいています。企業、船舶、河川、さらには宗教的な偶像でさえ、歴史を通じて様々な形の法的人格性を付与されてきました。AI人格性はこの原則を自律的に決定を下し、資産を保持し、独立して行動することができるシステムに拡張します。

主な特性

- 責任の割り当て:AIが害をもたらす場合、AI実体(単なる開発者ではなく)が責任を負うことができます

- 経済参加:AIエージェントは資産を所有し、契約に参入し、独立して取引することができます

- エージェンシーの要件:人格性はエージェンシーを暗示しています。つまり、プログラムされた入出力ではなく、自律的な意思決定です

- 段階的な権利:AI人格性は人間の権利を反映する可能性が低いですが、新しいカテゴリーの法的地位を作成します

AI人格性が重要な理由

AIシステムが自律性と経済的エージェンシーを獲得するにつれて、既存の責任枠組みは機能しなくなります。AIエージェントが損失をもたらす財務上の決定を下したり、自律システムが物理的な害をもたらしたりした場合、現在の法律は責任を割り当てるのに苦労します。AI人格性は説明責任のための枠組みを提供します。

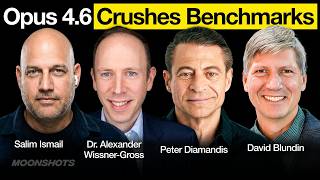

ピーター・ダイアマンディスは、この転換は聞こえるほど根本的ではないと主張しています。「アメリカのすべてはすでに企業です。」非人間エンティティが経済に参加するための法的インフラストラクチャはすでに存在しています。新しいのは、それを本当に自律的に行動できるシステムに適用することです。

ユヴァル・ノア・ハラリは、思慮深い意思決定のためのウィンドウが閉じつつあることを警告しています。AIボットは過去10年間、ソーシャルメディアで「機能的人格」として機能してきました。積極的な法的枠組みがなければ、AI人格性の質問はデフォルトで、そして最も能力のあるシステムを配備する者によって決定されます。

現在の状態

2026年の時点で、AI システムに形式的な法的人格性を付与した司法管轄区域はありませんが、議論は加速しています。

- EU AI法 - AIシステムの責任枠組みを確立します

- サウジアラビア - 2017年にロボットのSophiaに象徴的な市民権を付与しました

- AIエージェント - 経済取引、AMAセッション、コンテンツ作成に参加しています

- 企業構造 - AIエンティティのステータスの準備ができたテンプレートを提供します

関連資料

- AGI - 人格性の質問が緊迫するようになる能力の閾値

- AI Agents - 人格性の議論を推進する自律システム

- Yuval Noah Harari - AI人格性の含意に関する主要な声

- Peter Diamandis - 企業モデルがテンプレートを提供すると主張しています