Andrej Karpathy: The Busy Person's Intro to LLMs

lecturetutorialtrainingresearch

The foundational talk on what LLMs actually are: two files, lossy compression of the internet, and why we don't fully understand how 100B parameters collaborate.

Read full article →Related Videos

How Agent Skills Work: Progressive Disclosure Explained

Anthropic · Wed Nov 26 2025 15:09:15 GMT+0100 (Central European Standard Time)

Satya Nadella on Microsoft's AGI Strategy: Models May Have a Winner's Curse

Dwarkesh Patel · Wed Nov 12 2025 10:02:10 GMT+0100 (Central European Standard Time)

Elon Musk: We're in the Hard Takeoff Right Now

Peter H. Diamandis · Wed Mar 11 2026 01:00:00 GMT+0100 (Central European Standard Time)

Sam Altman: Intelligence Will Be a Utility Like Water

DRM News · Wed Mar 11 2026 01:00:00 GMT+0100 (Central European Standard Time)

Steve Yegge: Big Tech Is Quietly Dying

The Pragmatic Engineer · Wed Mar 11 2026 01:00:00 GMT+0100 (Central European Standard Time)

Dario Amodei: 10x Growth and Why 'Doomer' Makes Him Angry

Big Technology Podcast · Wed Jul 30 2025 02:00:00 GMT+0200 (Central European Summer Time)

OpenRouter COO: How Agents Are Actually Going Into Production

AI Day · Wed Jan 28 2026 01:00:00 GMT+0100 (Central European Standard Time)

Moltbot Creator Interview: How to Succeed at Agentic Coding

The Pragmatic Engineer · Wed Jan 28 2026 01:00:00 GMT+0100 (Central European Standard Time)

Jensen Huang CES 2025: Agentic AI Is the New Platform

NVIDIA · Wed Jan 07 2026 01:00:00 GMT+0100 (Central European Standard Time)

9 Components of an AI Operating System for Business

Daron Vener · Wed Feb 25 2026 01:00:00 GMT+0100 (Central European Standard Time)

Mitchell Hashimoto's New Way of Writing Code

The Pragmatic Engineer · Wed Feb 25 2026 01:00:00 GMT+0100 (Central European Standard Time)

Letter AI Raises $40M for AI-Native Sales Agents

YC Root Access · Wed Feb 25 2026 01:00:00 GMT+0100 (Central European Standard Time)

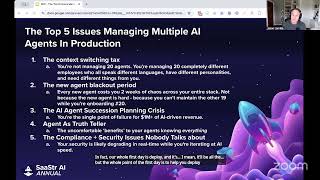

Top 5 Issues Managing 20+ AI Agents in Production

SaaStr AI · Wed Feb 25 2026 01:00:00 GMT+0100 (Central European Standard Time)

Simple AI Upsells 30% Better Than Trained Reps

YC Root Access · Wed Feb 18 2026 01:00:00 GMT+0100 (Central European Standard Time)

OpenClaw: Why Agentic Engineering Beats Vibe Coding

Lex Fridman Podcast · Wed Feb 11 2026 01:00:00 GMT+0100 (Central European Standard Time)

Grady Booch: Why AI Won't Kill Software Engineering

The Pragmatic Engineer · Wed Feb 04 2026 01:00:00 GMT+0100 (Central European Standard Time)

Andrew Ng's AI Career Advice: PM Skills Beat Pure Tech

Stanford Online · Wed Dec 17 2025 13:00:00 GMT+0100 (Central European Standard Time)

Hinton & Jeff Dean: The Collaboration That Built Modern AI

Radical Ventures · Wed Dec 17 2025 01:00:00 GMT+0100 (Central European Standard Time)

Serio: Next Billionaires Will Be Creators, Not Engineers

AI Engineer · Wed Dec 10 2025 14:36:29 GMT+0100 (Central European Standard Time)

SaaStr Now Runs 20+ AI Agents (More Than Humans): Here's the Data

SaaStr · Wed Dec 10 2025 08:34:57 GMT+0100 (Central European Standard Time)